In due settimane, nella prima metà del maggio 2023, il numero di siti di notizie e informazioni generati dall’intelligenza artificiale – e che operano con poca o nessuna supervisione umana – è più che raddoppiato, secondo un’analisi di NewsGuard.

Alla data del 19 maggio, NewsGuard ha identificato 125 siti interamente o prevalentemente generati da strumenti basati sull’IA. Solo due settimane prima questi siti erano 49, il che suggerisce che la tecnologia innovativa viene utilizzata in modo sempre più pervasivo per produrre siti di notizie e informazioni di bassa qualità. Per tali siti, la principale opportunità di guadagno consiste nell’attrarre pubblicità programmatica dai grandi marchi occidentali, che finiscono per sostenerli, seppur involontariamente, attraverso i loro investimenti pubblicitari.

“content farm”

NewsGuard monitora l’attendibilità dei siti d’informazione del mondo. E’ supportata da Google Chrome, Microsoft Edge, Firefox e Safari. NewsGuard trae profitto da aziende tecnologiche e operatori del settore pubblicitario, i quali ritengono che l’attività di valutazione e filtro preventivo sul traffico Internet degli utenti tuteli il valore economico dei marchi aziendali, sottraendo lettori ai siti che potrebbero danneggiarne l’immagine pubblica, vanificando gli investimenti promozionali.

Poiché il numero di “content farm” generate dall’intelligenza artificiale continua ad aumentare, NewsGuard ha annunciato i parametri per definire i siti “UAIN”, ovvero i siti inaffidabili di notizie generati dall’intelligenza artificiale (”Unreliable AI-Generated Site”).

Questo genere di siti devono soddisfare tutti e quattro questi criteri:

1. Esistono prove inconfutabili che una parte sostanziale dei contenuti del sito è prodotta dall’IA.

2. Ci sono prove certe che i contenuti vengono pubblicati senza una significativa supervisione umana. Ad esempio, numerosi articoli contengono messaggi di errore o altre formule tipiche delle risposte dei chatbot, dimostrando dunque che il contenuto è stato prodotto da strumenti di IA senza un adeguato controllo. (È probabile che già oggi o in futuro molti siti di notizie si servano di strumenti di IA, ma a ciò uniscano anche un’efficace supervisione umana; questi siti non saranno considerati UAIN).

3. Il modo in cui il sito si presenta potrebbe indurre il lettore medio a credere che i suoi contenuti siano prodotti da scrittori o giornalisti umani, perché ha un nome generico o innocuo, e l’aspetto o altri contenuti tipici dei siti di notizie e informazioni tradizionali.

4. Il sito non rivela chiaramente che i suoi contenuti sono prodotti da IA.

nomi generici

Nel caso in cui gli analisti di NewsGuard sospettino di avere a che fare con un sito di questo tipo, prima di pubblicare la valutazione chiederanno un commento ai proprietari del sito stesso, quando questi possono essere identificati o rintracciati.

Proprio come le fonti identificate dalla precedente analisi di NewsGuard, anche i nuovi siti individuati hanno sfornato decine e talvolta centinaia di articoli clickbait e di scarsa qualità. Alcuni di questi articoli includono affermazioni false, tra cui bufale sulla morte di celebrità, eventi o fatti inventati e articoli che presentano notizie accadute in passato come se fossero recenti. Questi siti sono apparentemente progettati per massimizzare le entrate pubblicitarie programmatiche attraverso gli annunci inseriti da aziende di tecnologia pubblicitaria. I gestori di questi siti scelgono nomi generici come iBusiness Day, Ireland Top News e Daily Time Update, facendoli apparire come pubblicazioni giornalistiche create e gestite in modo tradizionale, che si occupano di vari argomenti tra cui politica, tecnologia, intrattenimento e viaggi.

ceco e tagalog

I 125 siti generati dall’intelligenza artificiale identificati da NewsGuard sono scritti in dieci lingue: arabo, cinese, ceco, francese, indonesiano, inglese, olandese, portoghese, tagalog e thailandese.

NewsGuard ha trovato sui siti stessi chiari indizi del fatto che i contenuti sono stati generati dall’IA, tra cui articoli che contengono messaggi di errore chiaramente generati dai chatbot basati sull’intelligenza artificiale. Ad esempio, su questi siti si possono spesso trovare formule tipiche delle risposte generate dall’IA, tra cui “come modello di linguaggio IA, non posso completare questo compito” e “non ho accesso agli eventi attuali”. I siti sono generalmente gestiti in modo anonimo, pubblicano articoli privi di titoli e includono pagine relative alle informazioni generali e all’informativa sulla privacy che sembrano essere state prodotte tramite algoritmi.

Come avvenuto con i siti individuati precedentemente da NewsGuard, anche in quelli appena identificati gli strumenti di intelligenza artificiale sono stati utilizzati per produrre affermazioni false o infondate sulla salute e sulla politica.

Ad esempio, il sito gestito in modo anonimo Medical Outline, che afferma che i suoi contenuti mirano a soddisfare “parametri di originalità, credibilità e veridicità”, ha pubblicato più di 50 articoli generati dall’IA che forniscono consigli medici, secondo quanto rilevato da NewsGuard. Molti articoli promuovono rimedi naturali per la salute non comprovati e potenzialmente dannosi, con titoli come “Il limone può curare l’allergia alla pelle?”, “Quali sono i 5 rimedi naturali per l’ADHD?” e “Come prevenire il cancro in modo naturale”.

udienza al Congresso

Questi risultati giungono a qualche giorno dall’udienza tenutasi il 16 maggio 2023 presso il Congresso degli Stati Uniti, in cui l’amministratore delegato di OpenAI, Sam Altman, ha ammesso che una “significativa area di preoccupazione” è “la capacità generale di questi modelli di manipolare, persuadere e fornire una sorta di disinformazione interattiva basata sull’interazione uno-a-uno…”. OpenAI gestisce ChatGPT, uno tra i principali strumenti basati sull’intelligenza artificiale generativa.

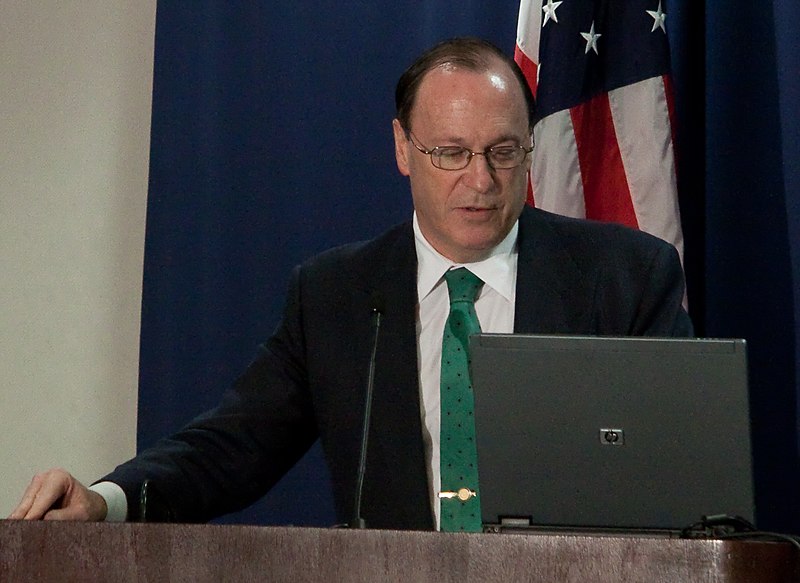

“I consumatori di notizie si fidano sempre meno delle fonti di informazione, anche perché è diventato difficile distinguere una fonte generalmente affidabile da una fonte generalmente inaffidabile”, ha dichiarato Steven Brill, co-CEO di NewsGuard. “Questa nuova ondata di siti creati dall’intelligenza artificiale renderà ancora più difficile per i consumatori sapere chi fornisce loro le notizie, abbassando ulteriormente il livello di fiducia”.

“Il settore della pubblicità programmatica, che per sua natura funziona in modo opaco, ha favorito questa nuova ondata di utilizzo dell’IA per aumentare le visualizzazioni delle pagine e attirare così introiti pubblicitari”, ha dichiarato Gordon Crovitz, co-CEO di NewsGuard. “I marchi, le agenzie pubblicitarie e le società di tecnologia pubblicitaria stanno ora finanziando involontariamente queste operazioni basate sull’IA, incoraggiando la creazione di siti che si spacciano per fonti di giornalismo affidabile”.

(nella foto, Steven Brill)